Hallo, heute gibt es mal ein Thema das mich als ausgebildeten Mediengestalter seit ein paar Tagen stark beschäftigt, fasziniert und beängstigt zugleich: „ai generated images“ (ai steht für artificial intelligence also künstliche Intelligenz). Was soll das sein? Im Grunde genommen bedeuted es, dass ein künstliche Intelligenz auf eine kurze Textanweisung hin ein Bild zeichnet. Aber nicht nur irgendein willkürliches Bild, sondern ein spezifisches und teilweise extrem kreatives und gut getroffenes.

Ich schreibe ihr z.B. „ein Drache in einer Eislandschaft“ oder „eine Kolonie auf dem Mars“ oder „eine kaputte Ölpipeline“ und genau das malt die KI dann. Und ich kann ihr auch noch mitteilen in welchem Style ich das Ganze gerne hätte, also z.B. möchte ich eine Bleistiftzeichnung oder soll es realistisch sein, im Comicstil oder doch lieber ein van Gogh?

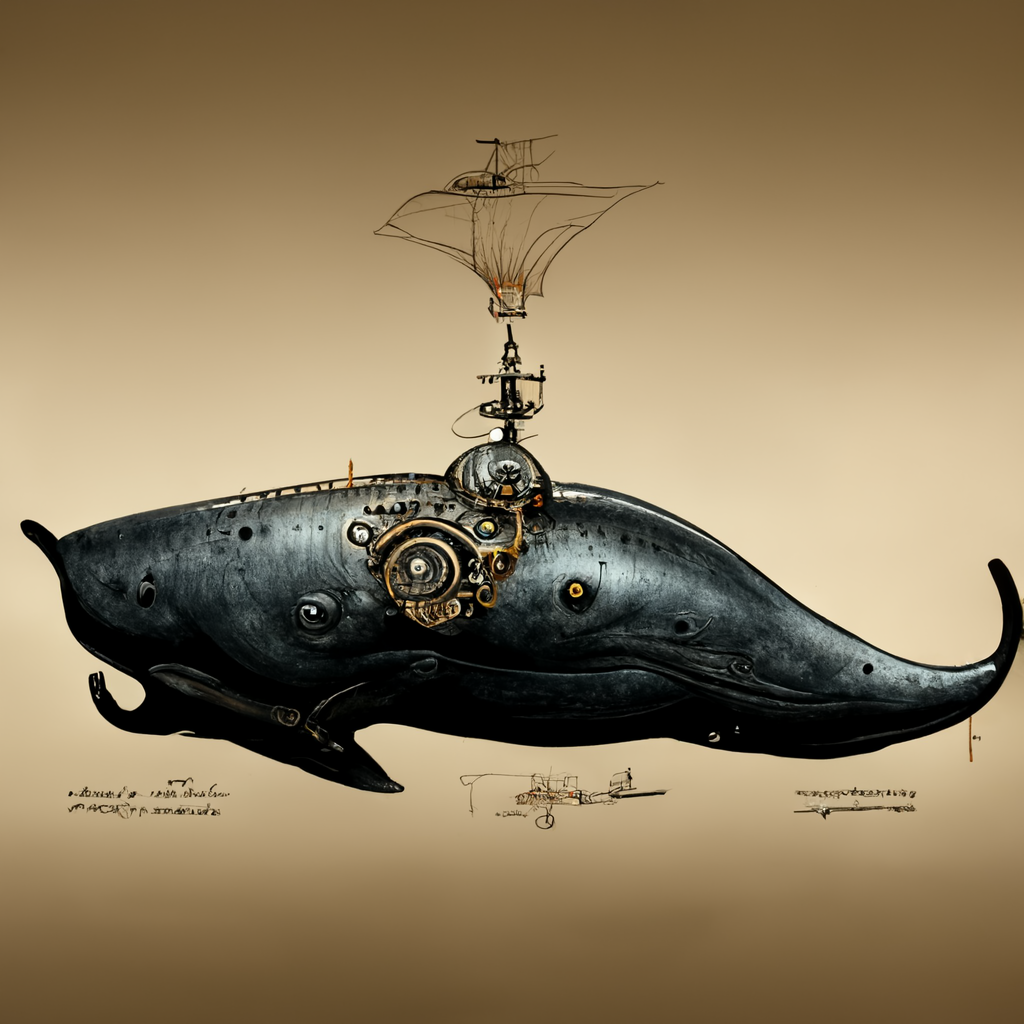

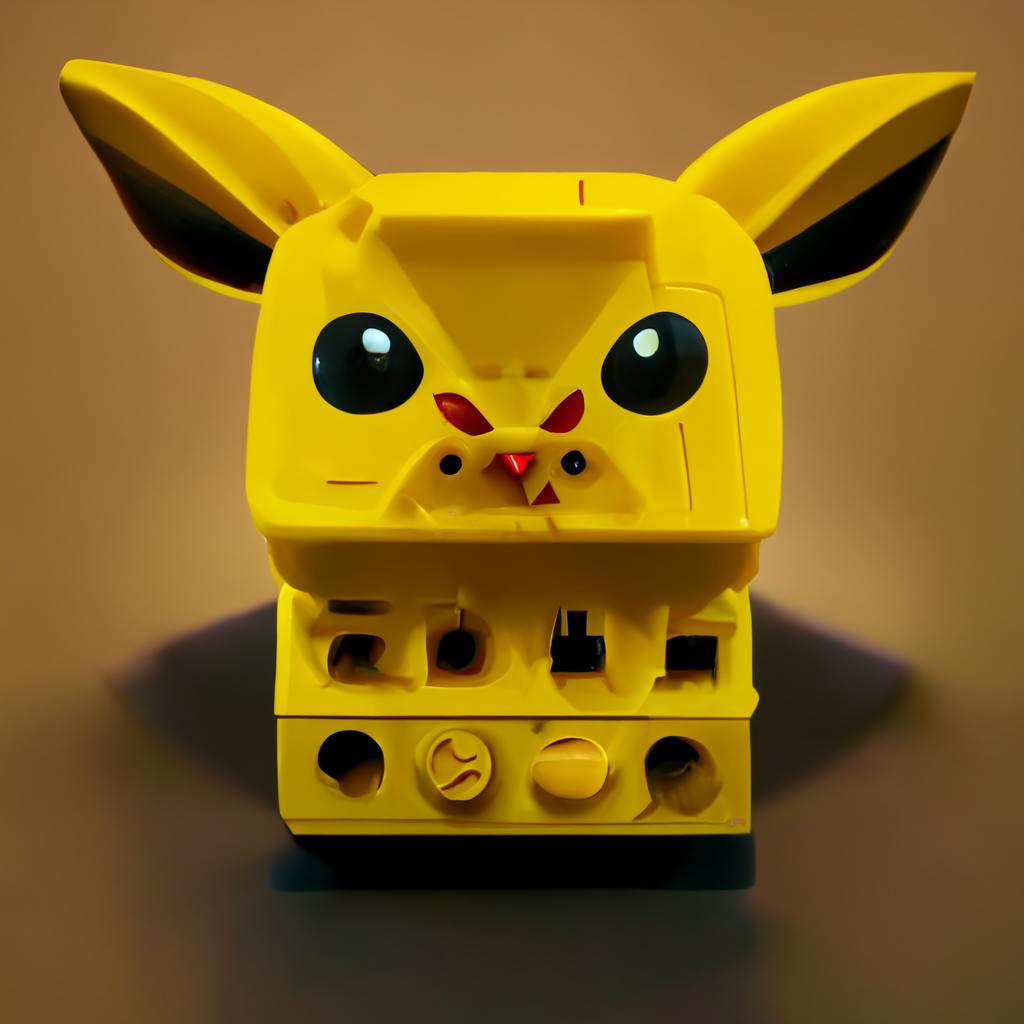

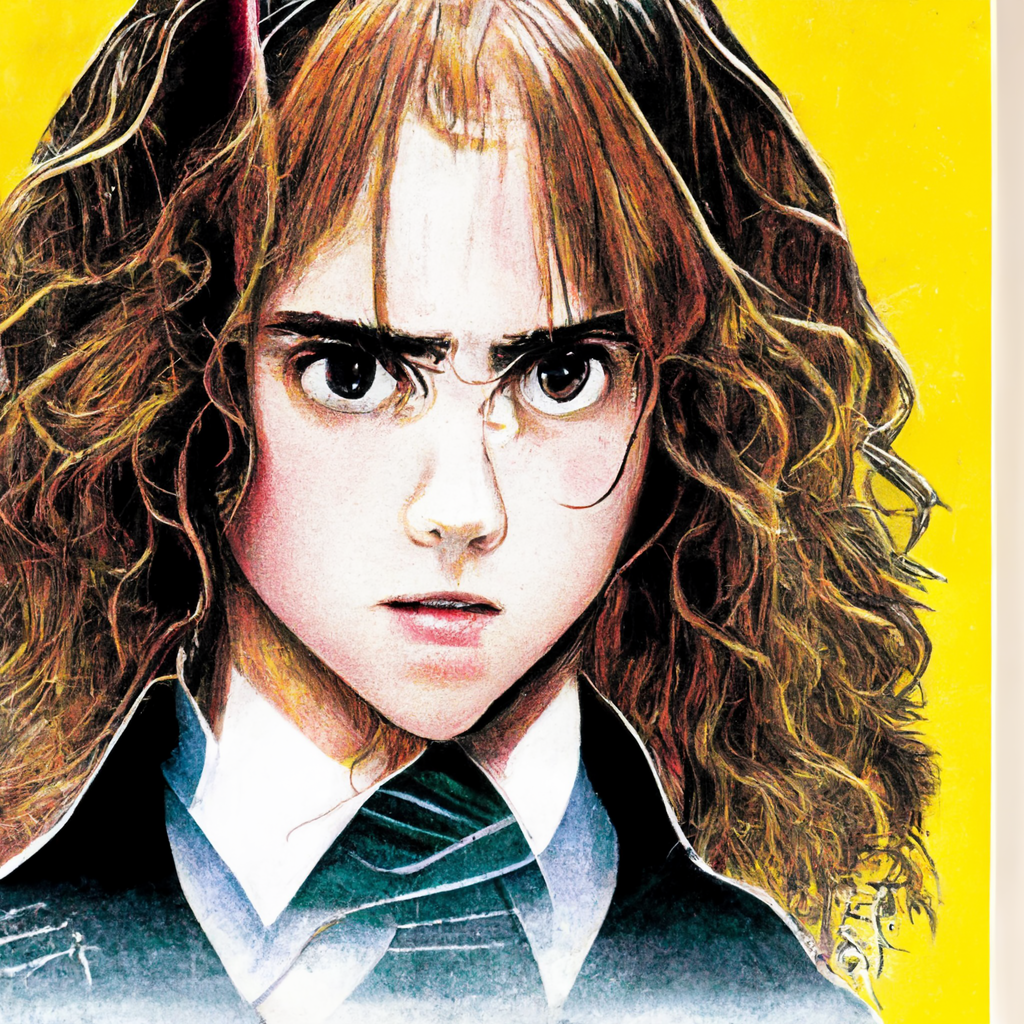

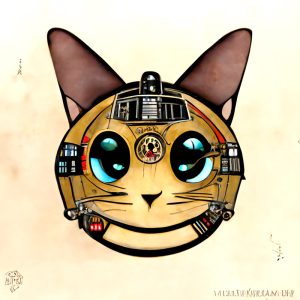

Es klingt unglaublich und das waren meine ersten Gehversuche auch. Ich komme seit zwei Wochen aus dem Staunen nicht mehr heraus und bevor ich zuviel erzähle, lasse ich ein paar Bilder sprechen:

Jeder kann von heute auf morgen zum großen Künstler werden

Und das alles nur mit einer kleinen Zeile beschreibenden Text! Die allerdings noch in englischer Sprache sein muss, aber das sollte dank Deepl, etc. heutzutage kein Problem mehr sein. Hinzu kommt, dass kein Bild dem anderen gleicht. Theoretisch gibt es also keine Probleme mit irgendwelchen Urheberrechten, aber dazu komme ich später noch.

Meine hauptsächlichen Erfahrungen beschränken sich momentan auf Midjourney, da dessen Bedienung über den discord chat sehr einfach und schnell ist und die Ergebnisse faszinieren. Außerdem kann man da bei den anderen „spicken“, da die Generierungen für alle User, die nicht extra für die Geheimhaltung bezahlen, einsehbar sind. Zu Dall-E 2 habe ich leider noch keinen Zugang erhalten. Die Links sind am Ende der Seite.

Nur noch wenige Hürden bis zur grafischen Revolution

Natürlich ist die Technik noch nicht ganz ausgereift, die momentanen ai-Dienstleister bieten entweder nur kleine Auflösungen an, die nicht für hochauflösende Verwertungen geeignet sind oder die Berechnungszeiten werden zu lange. Außerdem hat Midjourney noch große Probleme mit Gesichtern, Gliedmaßen und bei den höheren Auflösungen sind dann jede Menge Artefakte zu sehen, aber hier wird stetig weiterentwickelt.

Kleine Anekdote: Ich habe Disco Diffusion lokal auf meinen PC installiert und konnte mit meiner RTX3060 Grafikkarte (die immerhin über 12GB VRAM verfügt) gerade mal ein Bild in einer 1k-Auflösung herausrendern. Bei höheren Auflösungen bekomme ich einen „out of memory“-Fehler. Hab danach auf meine CPU (5950x) mit ganzen 128GB RAM umgestellt (als 3D-Hobby-Artist braucht man viel RAM, aber die hat der Otto-Normal-User wohl kaum zuhause) und konnte damit dann tatsächlich ein 4k-Bild generieren… bei einer sagenhaften Berechnungszeit von 48 Stunden für ein Bild. Das habe ich natürlich nur einmal testhalber gemacht und dann kein zweites Mal. Die schnellen Serverdienstleister sind anscheinend mit den A100 Prozessoren ausgestattet.

Hier nochmal ein paar Beispiele, dieses mal mit den Text-Prompts dazu:

Zu viele Details verwirren noch

Schwierig wird es wenn man nur Teile eines KI-geschaffenen Bildes verändern möchte, denn alles ist immer ein Gesamtkunstwerk und jede neue Generierung kann wieder ganz anders aussehen.

Hinzu kommt, dass man zwar genug Platz hat, um größere Anweisungen zu schreiben, aber eine Collage zusammenstellen geht (noch) nicht. Also wenn ich der KI schreibe: „Mal mir ein Bild mit einer Kreatur die vier Arme, zwei Beine und einen halbkugelförmigen Kopf mit drei roten Augen hat“, dann ist es vorbei mit der treffenden Kunst. Was er nicht kennt, kann er auch nicht abbilden.

Es ist wohl so, dass die künstlichen Intelligenzen einen Speicher an Bildern aus dem Netz im Kopf haben und sich bei Ihrer kreativen Arbeit daran orientieren. Perry Rhodan gehört leider nicht zu Ihrem Repertoire, obwohl es die größte Science-Fiction-Serie der Welt ist… aber halt in den USA kaum bekannt. Wer die Serie kennt, wird meinen Wink verstehen ;-).

Aus Film, TV und Spiel bekannte Begriffe laufen am Besten

Anders sieht es aus wenn es um Marvel, Disney und Co geht. Deswegen werden diese Begriffe gerne in die Text-Prompts übernommen. Ebenso wie z.B. 3D Renderer wie „octane“, „unreal engine“ oder „artstation“ als Referenz. Stimmungen erzeugen geht auch recht einfach mit Begriffen wie „epic, atmospheric, dramatical“.

Für Umgebungen gibt es beispielsweise diese Begriffe:

„hill, mountains, sunset, field, world, ocean, trees, underground, city, village, path, urban, mountain, buildings, waterfall, skyline, nature, town, industrial, architecture, road, jungle, valley, bridge, horizon, landscape, house, building, environment, wilderness, enviroment, river, cave, desert, forest“

Der Bildausschnitt kann so bestimmt werden:

„portrait, headshot, ultrawide shot, extreme closeup, macro shot, an expansive view of“

Sind die grafischen Berufe bald am Ende?

Das wohl nicht, aber sie werden sich stark verändern. Ich bin überzeugt, dass die künstliche Intelligenz zu einer disruptiven Revolution in der Grafikbranche führen wird. „Disruptiv“ heißt weltenverändernd und das im wahrsten Sinne des Bildes. Ob man einen Mediengestalter, Grafiker, Illustrator oder Zeichner zukünftig nur noch „ai-Operator“ nennen wird, weiß ich nicht, aber es wird bei einigen, die derzeit noch auf einem hohen Ross sitzen, zu einem tiefen Fall führen. Der kreative Gestalter an sich wird stark an Reputation verlieren, denn wer kann schon so genau sagen, wer da wirklich kreativ war!?

Die Ausbildungen werden ebenso überdacht werden müssen, wie jeder optisch kreative Arbeitsplatz. Freelancer, wie ich, werden sich als erstes auf die neue Technik stürzen und alle anderen werden, sowohl aus Kostengründen, Zeitersparnis und, ich muss es so deutlich sagen, leider bzw. überraschenderweise auch aus Gründen der Kreativität, folgen.

Die Preise für kreative Kunst werden ins bodenlose fallen und Redakteure werden sich die „Schmuckbilder“ in Zukunft für Ihre Artikel selbst generieren lassen. Die Stockfotografie wird ins Stocken kommen, denn man muss sich dann vielleicht gar keine Bilder mehr einkaufen, sondern macht sie sich geschwind selbst.

Adobe Stock, Shutterstock, Depositphotos und Co werden bereits jetzt mit diesen Bildern geflutet und dann, irgendwann in fenrer Zukunft, werden sie in die Bedeutungslosigkeit verfallen oder sich spezialisieren. Dasselbe Spiel beim Online-Gemäldehandel z.B. auf Artfinder und Saatchi Art, dort wird dann wohl nur noch offensichtlich gemalte Kunst vernünftige Preise bringen. Die Zeit der teuren Kunstdrucke ist vorbei. Auf Fiverr findet man bereits die ersten Angebote von „Grafikern“.

Die Umwälzung, sobald sich jeder „Bürohengst“ mit ein paar Worten individuelle und qualitativ hochwertige Bilder generieren kann, wird gigantisch und durch alle Branchen hindurch die Runde machen, natürlich auch in der Spielebranche, in der gerade die stimmungsvollen SciFi und Fantasy Motive quasi ein Heimspiel für die AI sind.

Es werden natürlich weiterhin „menschliche“ Fähigkeiten mit grafischen Programmen, wie z.B. Photoshop, gebraucht werden, aber eventuell nur noch für Retouchen, Anpassungen und spezifische Umsetzungen. Die kreative Vorarbeit, z.B. ein Concept Art, macht die KI auf eine simple Textanweisung. Für Videos sind die Rechenkapazitäten noch zu klein, aber auch das wird eines Tages kommen.

Wie sieht es mit dem Urheberrecht aus?

Das ist eine äußerst spannende Frage mit der sich vermutlich auch bald die ersten Gerichte herumschlagen dürfen. Theoretisch hat eigentlich die AI bzw. der berechnende Prozessor das Urheberrecht. Weder das Unternehmen das die künstliche Intelligenz programmiert hat, noch der Anwender der die Textanweisung geschrieben hat, sind, genau genommen, Urheber. Aber ich bin kein Rechtsanwalt um das zu entscheiden.

Praktisch ist die KI juristisch stark unterrepräsentiert und wird momentan niemanden verklagen, jedoch was passiert wenn zwei Artists ein ähnliches Bild, Logo, etc. herausgeneriert haben. Wer zuerst kommt, mahlt zuerst? Darf man diese Bilder überhaupt verkaufen? Ist eine Urheberschaft und damit ein Nutzungsrecht überhaupt anerkennbar, wenn man nur ein paar Worte an die KI eintippt? Und wie will man das beweisen? Was wenn mir jemand mein Bild klaut und einfach behauptet, dass er es generiert hat? Muss ich dann für jedes Bild ein NFT anlegen? 😂

Was sagt Ihr dazu?

Hier kann man sich für MidJourney anmelden

Hier kann man sich für Dall-E 2 anmelden

Hier ein Link zu der frei nutzbaren Software Disco Diffusion

Wow, ich bin sprachlos. Sehr krasse Software und tolle Bilder! Guter Artikel!